In der klassischen Psychologieausbildung sammeln Studierende praktische Erfahrung, indem sie unter Aufsicht an Therapiesitzungen mit echten Patientinnen und Patienten teilnehmen. Sie lernen durch Beobachten und beteiligen sich später unter Supervision aktiv an realen Sitzungen. Dieses Modell stößt jedoch an klare Grenzen, wenn es darum geht, ausreichend Übungsvolumen für eine echte klinische Kompetenz bereitzustellen:

Die Anzahl möglicher Sitzungen ist durch Termin- und Supervisionsverfügbarkeit begrenzt;

Die Einwilligung der Patientinnen und Patienten zieht der Beteiligung von Studierenden klare Grenzen;

Das Risiko, dass unerfahrene Behandler – auch unter Aufsicht – Schaden anrichten, ist nicht zu vernachlässigen.

Entscheidender ist: Studierende kommen kaum dazu, selbst auf eine Patientin oder einen Patienten zu reagieren. Solange das klinische Urteilsvermögen noch nicht ausgereift ist, birgt jeder eigene Wortbeitrag ein reales Risiko psychischer Belastung. Schon unglücklich gewählte Worte einer ungeübten Person können im therapeutischen Kontext Schaden anrichten.

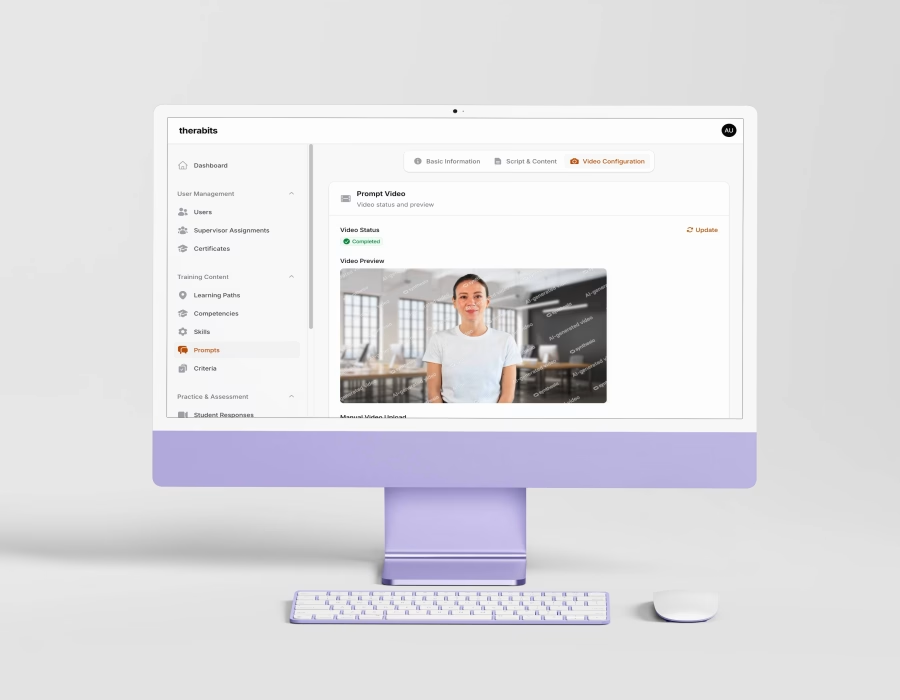

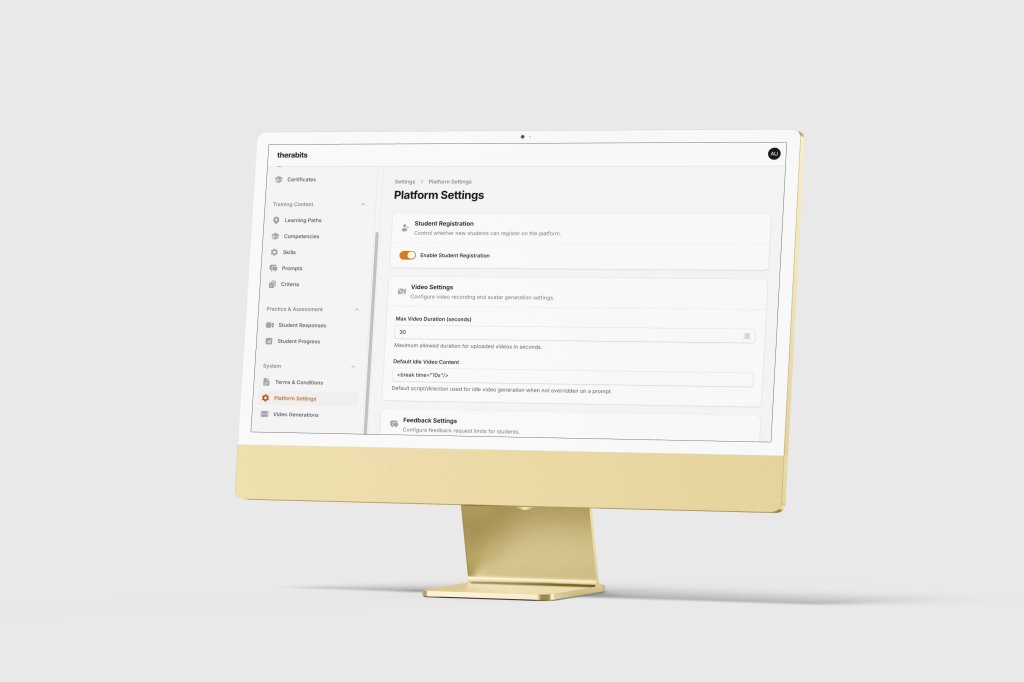

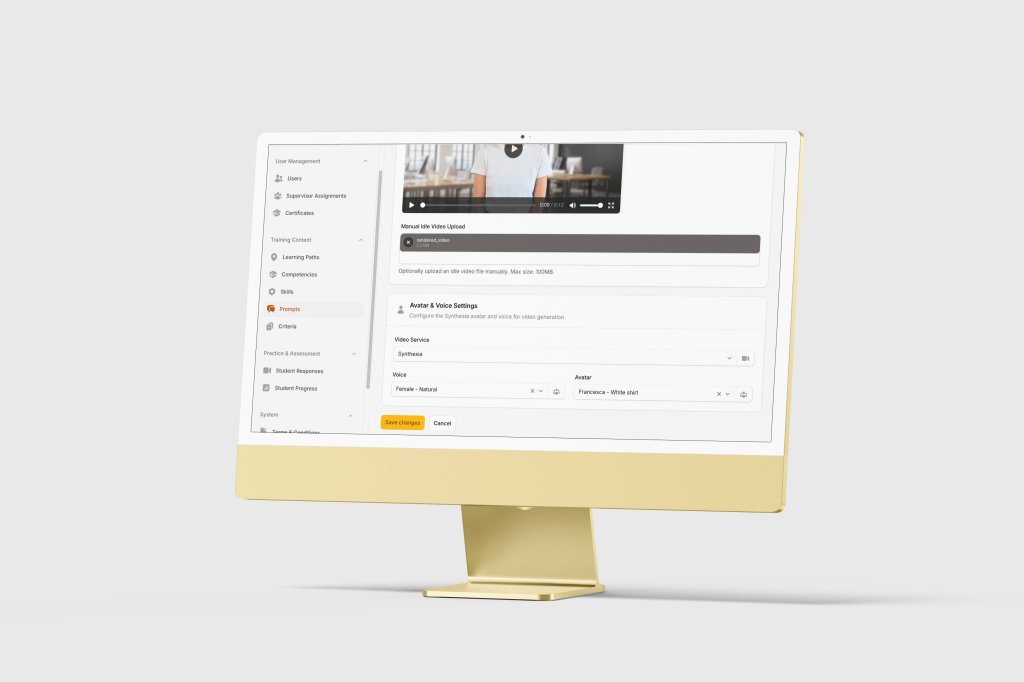

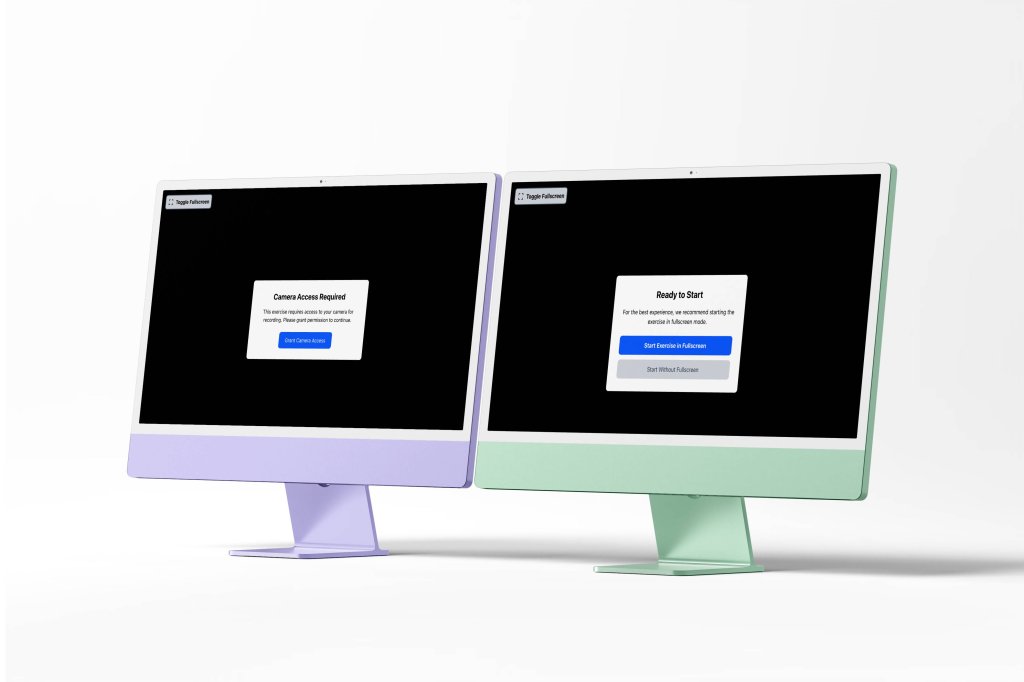

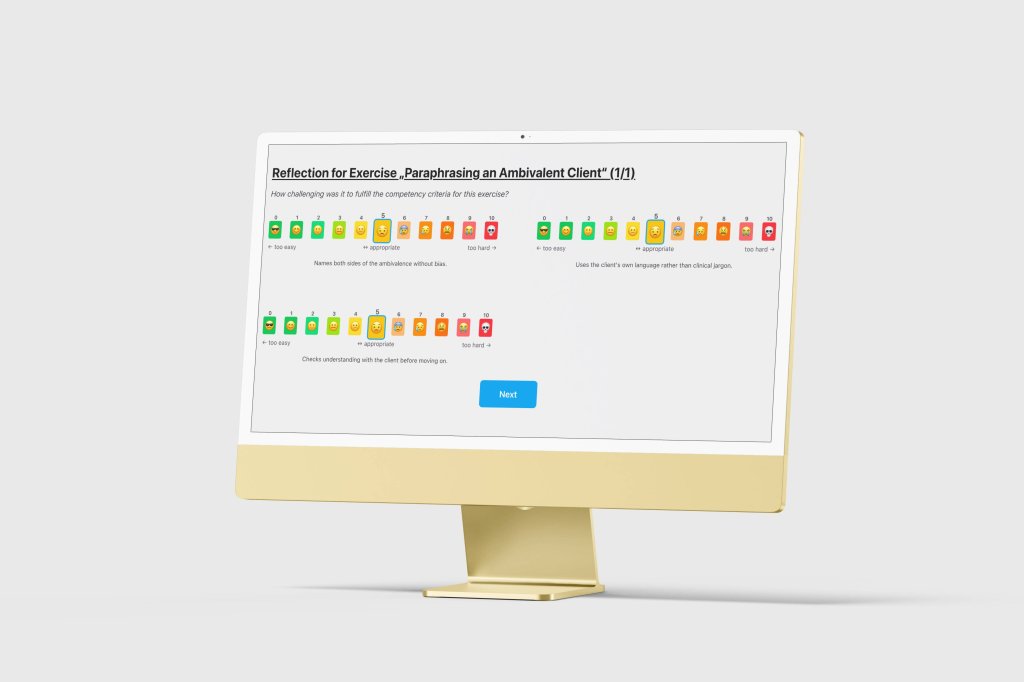

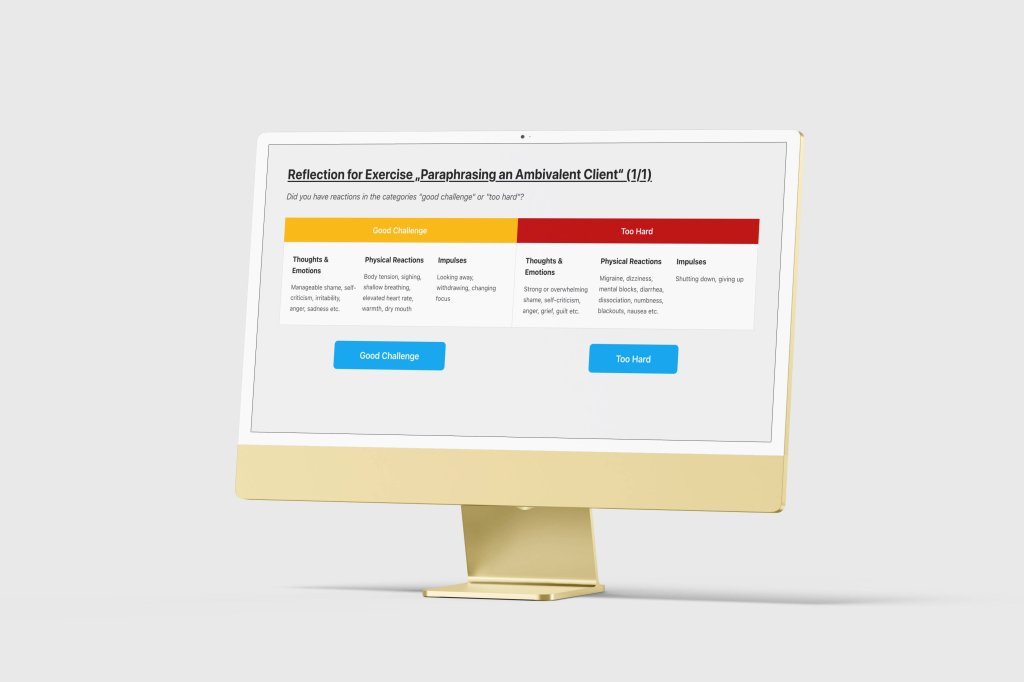

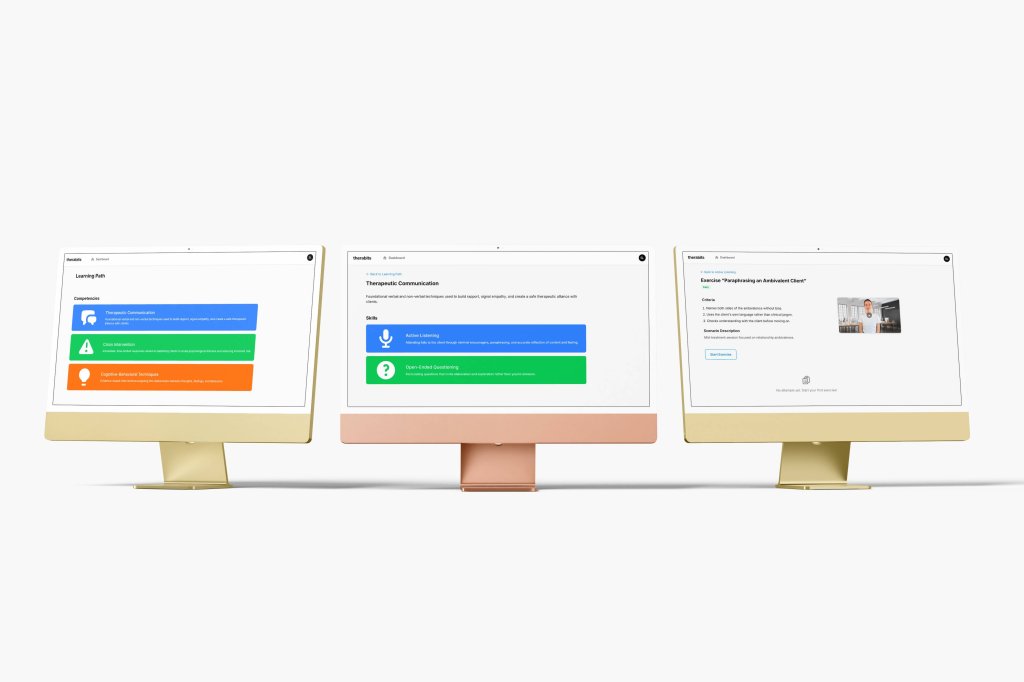

Die Universität wollte diese Engstelle auflösen: deutlich mehr Übungsszenarien in größerer Vielfalt – ohne reale Patientinnen und Patienten zu gefährden. Therabits ersetzt dafür den realen Patienten durch einen KI-generierten Avatar, der realistische psychische Krankheitsbilder als vorgerendertes Video präsentiert. Studierende treten mit der Simulation in einen Dialog wie in einer realen Sitzung, zeichnen ihre Antworten auf und erhalten anschließend strukturiertes Feedback ihrer Supervisorin oder ihres Supervisors.

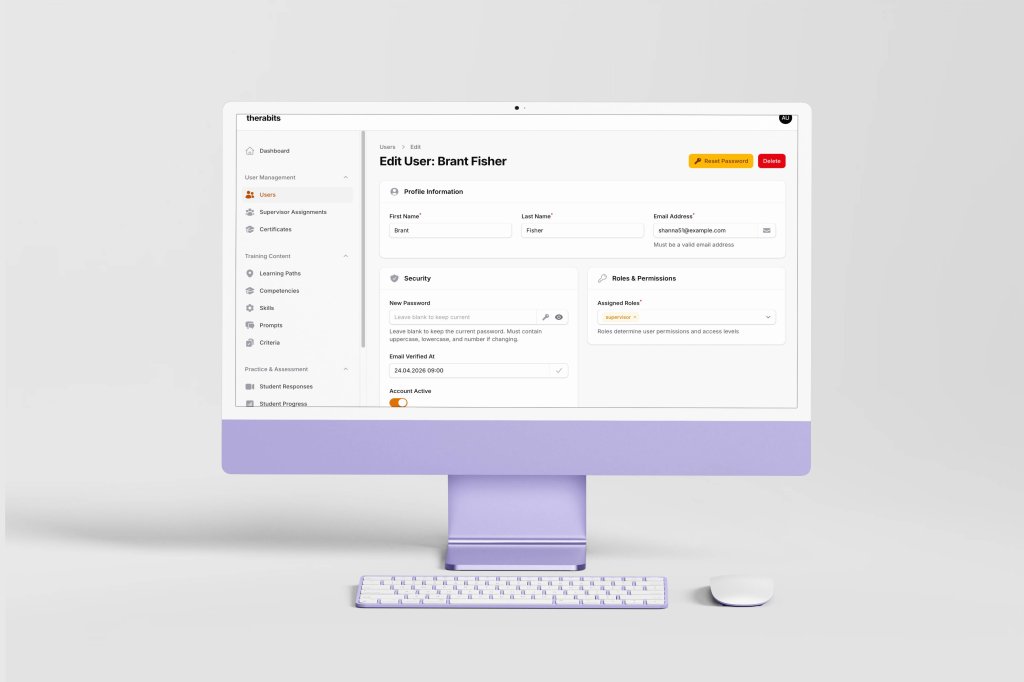

Therabits bedient drei klar getrennte Nutzergruppen:

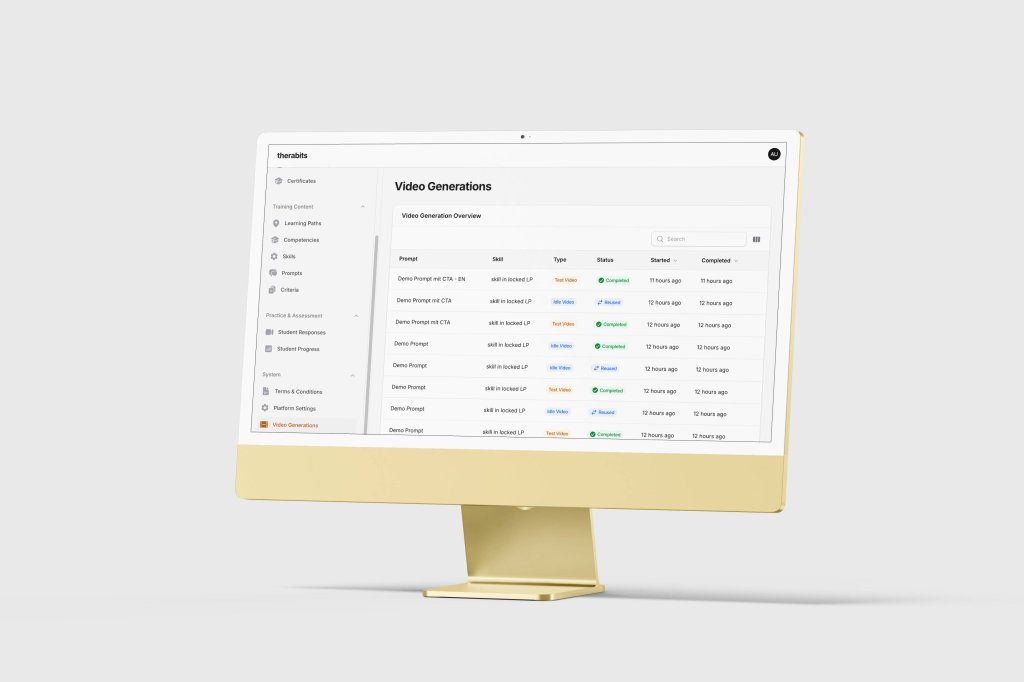

Autorinnen und Autoren: erstellen die Skripte (Prompts), aus denen die KI-Avatare generiert werden.

Supervisoren: kuratieren die Trainingsinhalte, konfigurieren Lernpfade und bewerten die Leistung der Studierenden.

Studierende: Psychologiestudierende und Ausbildungsteilnehmende durchlaufen die Übungen als Teil ihres Curriculums.

Die Anwendung ist kein Endkundenprodukt und nicht für den öffentlichen oder kommerziellen Einsatz vorgesehen. Sie ist ein institutionelles Forschungsinstrument für ein konkretes, akkreditiertes Ausbildungsprogramm.

Über die Trainingsfunktion hinaus hat das Projekt eine Forschungsdimension: Die Universität führt eine formelle Studie durch, um zu evaluieren, ob KI-generierte Simulationen eine pädagogisch wirksame und klinisch belastbare Methode der Psychologie-Ausbildung darstellen. Die Web-Anwendung ist sowohl Werkzeug als auch – in gewissem Umfang – Gegenstand dieser Studie.